الگوریتم K نزدیک ترین همسایه (K-Nearest Neighbors)

الگوریتم K نزدیکترین همسایه یا KNN یکی از سادهترین و پرکاربردترین الگوریتمهای یادگیری ماشین با نظارت است که برای مسائل طبقهبندی و رگرسیون مورد استفاده قرار میگیرد. این الگوریتم با حفظ و استفاده از دادههای آموزشی به جای ساختن یک مدل داخلی، عملکرد متمایزی دارد. KNN به عنوان یک روش مبتنی بر نمونه (instance-based method) یا یادگیرنده تنبل (lazy learner) شناخته میشود، زیرا الگوریتم نیازی به مرحله آموزش مدل ندارد و از دادههای آموزش تنها در مرحله پیشبینی استفاده میکند. در واقع، این الگوریتم تنها نمونههای آموزشی را حفظ میکند و از آنها به عنوان “دانش” برای انجام پیشبینیها بهره میبرد.

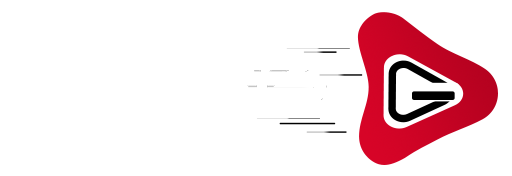

در مسائل طبقهبندی، الگوریتم KNN برای هر نمونه جدید k نزدیکترین همسایه را پیدا میکند و سپس با استفاده از رای اکثریت کلاسهای این همسایگان، کلاس نمونه جدید را پیشبینی میکند. به عبارت دیگر، هر نمونه به کلاسی اختصاص مییابد که در میان همسایگان نزدیکتر به آن بیشترین فراوانی را دارد.

در مسائل رگرسیون، الگوریتم KNN k نزدیکترین همسایه را شناسایی کرده و میانگین مقادیر این همسایگان را به عنوان پیشبینی مقدار نمونه جدید محاسبه میکند. به این ترتیب، مقدار پیشبینیشده بر اساس میانگین مقادیر همسایگان تعیین میشود.

پیاده سازی الگوریتم KNN شامل چه مراحلی است؟

بارگذاری دادهها : ابتدا دادههای آموزشی را بارگذاری میکنیم. این دادهها شامل نمونههای دادهای است که قبلاً برچسبگذاری شدهاند.

تعیین مقدار K : مقدار K را که نشاندهنده تعداد نزدیکترین همسایهها است، تعیین میکنیم. انتخاب مقدار مناسب برای K بسیار مهم است زیرا تأثیر زیادی بر دقت پیشبینیها دارد.

محاسبه فاصلهها برای هر نمونه جدید : برای هر نمونه داده جدید، فاصله آن را با تمام نمونههای موجود در دادههای آموزشی محاسبه میکنیم. فاصله اقلیدسی یکی از معیارهای معمول برای این محاسبات است. فاصلهها و شاخصهای نمونهها را در یک لیست ذخیره میکنیم.

مرتبسازی فاصلهها : لیست فاصلهها را براساس مقادیر فاصله، از کمترین به بیشترین، مرتب میکنیم. این کار به ما کمک میکند تا نزدیکترین همسایگان را به راحتی پیدا کنیم.

انتخاب K نزدیکترین همسایه : از بین لیست مرتبشده، K نمونه اول را به عنوان نزدیکترین همسایهها انتخاب میکنیم.

تعیین برچسب نمونه جدید : اگر مسئله مورد نظر رگرسیون باشد، میانگین برچسبهای K نزدیکترین همسایه را محاسبه میکنیم و آن را به عنوان برچسب نمونه جدید در نظر میگیریم. اگر مسئله طبقهبندی باشد، کلاس برچسبی که بیشترین فراوانی را در بین K همسایه دارد، به عنوان برچسب نمونه جدید اختصاص داده میشود.

ارزیابی مدل : بعد از تعیین برچسب، میتوان مدل را با استفاده از دادههای اعتبارسنجی (validation data) یا دادههای تست ارزیابی کرد تا دقت و عملکرد آن مشخص شود.

تنظیم و بهینهسازی K : با استفاده از روشهایی مانند اعتبارسنجی متقاطع (cross-validation) میتوان مقدار K را تنظیم و بهینهسازی کرد تا بهترین عملکرد را به دست آورد.

KNN در چه زمینه هایی کاربرد دارد؟

استخراج متن : یکی از مهمترین کاربردهای KNN در زمینه استخراج متن و الگو یابی است. این الگوریتم میتواند برای تشخیص سرقت ادبی مورد استفاده قرار گیرد. با تحلیل شباهتهای متنی، KNN میتواند متنهای مشابه را شناسایی و از کپیبرداری غیرمجاز جلوگیری کند.

کشاورزی : در بخش کشاورزی، الگوریتم KNN برای تشخیص و دستهبندی مکانیزه میوهها و محصولات کشاورزی به کار میرود. با استفاده از تصاویر و ویژگیهای مختلف محصولات، KNN میتواند محصولات را به دستههای مختلف تقسیم کند و فرآیندهای کشاورزی را بهبود بخشد.

سرمایهگذاری : الگوریتم KNN در پیشبینی و تحلیل بازار سرمایهگذاری نیز کاربرد دارد. با دستهبندی دادههای تاریخی و شناسایی الگوهای بازار، این الگوریتم میتواند به پیشبینی روندهای آینده و ارائه توصیههای سرمایهگذاری کمک کند.

پزشکی : در حوزه پزشکی، KNN برای دستهبندی بیماران، تشخیص پیشرفت بیماریها و بررسی اثرات داروها به کار میرود. این الگوریتم با تحلیل دادههای بیمارستانی و اطلاعات پزشکی، میتواند به پزشکان در تشخیص سریعتر و دقیقتر کمک کند.

تشخیص چهره : تشخیص چهره و پردازش تصویر از موضوعات داغ در دنیای تکنولوژی هستند. الگوریتم KNN یکی از موفقترین الگوریتمها در این زمینه است. با تحلیل ویژگیهای صورت و مقایسه با دادههای موجود، KNN میتواند افراد را شناسایی و هویت آنها را تأیید کند.

دستهبندی مشتریان : در حوزه دادهکاوی، دستهبندی مشتریان و ارائه پیشنهادات متناسب با سبد خرید آنها بسیار مهم است. KNN میتواند با تحلیل رفتار خرید مشتریان، آنها را به دستههای مختلف تقسیم کند و به کسبوکارها کمک کند تا استراتژیهای بازاریابی بهتری اتخاذ کنند.

سیستمهای توصیهگر : اپلیکیشنهای فروشگاهی و برنامههای مربوط به فیلم و موسیقی از محبوبیت بالایی برخوردارند. یکی از عوامل موفقیت این سیستمها، ارائه پیشنهادات نزدیک به سلیقه کاربر است. الگوریتم KNN در این زمینه بسیار مؤثر عمل میکند و میتواند تجربه کاربری را بهبود بخشد.

معایب الگوریتم K نزدیکترین همسایه

الگوریتم K نزدیکترین همسایه (KNN) با وجود مزایای متعدد، دارای معایبی نیز است که باید مورد توجه قرار گیرند:

زمان محاسباتی بالا :

یکی از نقاط ضعف اصلی الگوریتم KNN زمان محاسباتی بالای آن است. این الگوریتم به دلیل اینکه باید فاصله هر نمونه داده جدید را با تمام دادههای آموزشی محاسبه کند، میتواند در مجموعه دادههای بزرگ بسیار کند عمل کند. این مسئله به ویژه در کاربردهای بلادرنگ و زمانی که نیاز به پردازش سریع دادهها است، یک چالش محسوب میشود.

نیاز به حافظه زیاد :

الگوریتم KNN به مقدار زیادی حافظه نیاز دارد، زیرا باید تمامی دادههای آموزشی را ذخیره کند. این مسئله باعث میشود که برای دادههای بزرگ، حافظه مورد نیاز به شدت افزایش یابد و کارایی سیستم را تحت تاثیر قرار دهد. ذخیرهسازی دادههای حجیم میتواند به محدودیتهای سختافزاری منجر شود و عملکرد الگوریتم را کاهش دهد.

حساسیت به مقیاس داده ها :

KNN به مقیاس دادهها بسیار حساس است. اگر دادهها به درستی مقیاسبندی نشوند، ویژگیهای با دامنه بزرگتر میتوانند تاثیر بیشتری در محاسبه فاصلهها داشته باشند و نتایج را به طور نادرست تحت تأثیر قرار دهند. برای مثال، اگر ویژگیهای مختلف دارای واحدهای اندازهگیری متفاوت باشند، لازم است که دادهها نرمالسازی یا استانداردسازی شوند تا تاثیرات آنها در محاسبات فاصله یکنواخت شود.

انتخاب مقدار K :

انتخاب مقدار مناسب برای K بسیار مهم است. اگر K عدد بزرگی انتخاب شود، الگوریتم ممکن است پیشبینیهای نادرستی انجام دهد زیرا همسایگان بیشتری در نظر گرفته میشوند که ممکن است شامل دادههای نویزی یا نقاط دورافتاده باشند. از سوی دیگر، اگر K خیلی کوچک باشد، الگوریتم به نویز و ناهنجاریها حساستر میشود و دقت پیشبینی کاهش مییابد. تعیین مقدار بهینه K نیاز به آزمون و خطا دارد و ممکن است زمانبر باشد.

تاثیر نویز و ناهنجاری ها :

KNN به شدت به نویز و نقاط پرت حساس است. حضور دادههای نویزی میتواند باعث شود که پیشبینیها نادرست باشند زیرا این نقاط میتوانند به عنوان همسایگان نزدیک در نظر گرفته شوند و نتایج را تحت تاثیر قرار دهند. برای کاهش تاثیر نویز، میتوان از تکنیکهای پیشپردازش دادهها مانند حذف نقاط پرت استفاده کرد.

کارایی پایین در دادههای با ابعاد بالا :

در مجموعه دادههای با ابعاد بالا، که هر نمونه دارای ویژگیهای زیادی است، کارایی KNN به شدت کاهش مییابد. این پدیده به عنوان “نفرین ابعاد” شناخته میشود. در چنین حالتی، فاصله بین نقاط داده به طور یکنواخت افزایش مییابد و تمایز بین همسایگان نزدیک و دور سختتر میشود. برای مقابله با این مشکل، میتوان از تکنیکهای کاهش ابعاد مانند PCA استفاده کرد.

عدم تفسیرپذیری :

یکی دیگر از معایب KNN عدم تفسیرپذیری آن است. برخلاف مدلهای یادگیری ماشینی مانند درختهای تصمیم، که میتوانند قوانین تصمیمگیری شفاف و قابل فهم ارائه دهند، KNN صرفاً بر اساس محاسبات فاصله عمل میکند و توضیح دقیقی برای نتایج پیشبینیشده ارائه نمیدهد. این موضوع میتواند در کاربردهایی که تفسیر نتایج اهمیت دارد، یک محدودیت محسوب شود.

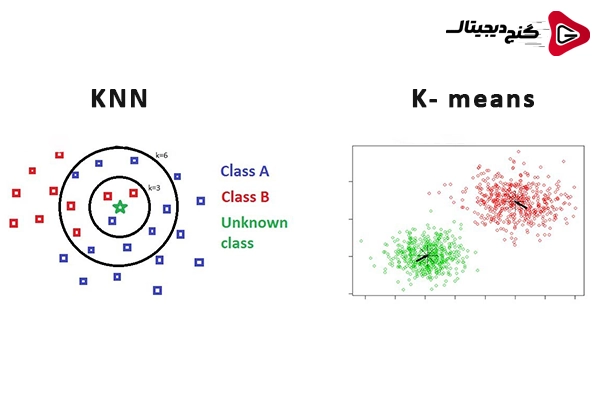

تفاوتهای میان KNN و K-Means

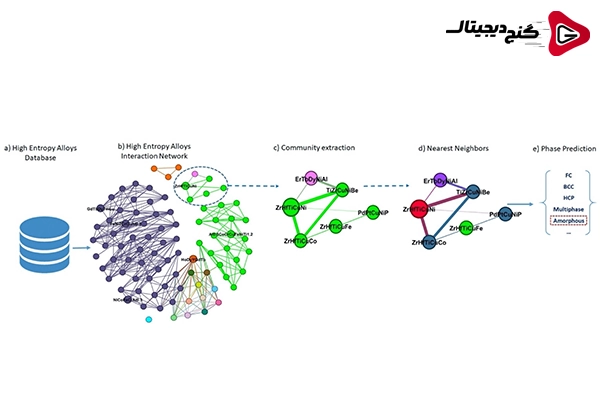

الگوریتمهای KNN (K-Nearest Neighbors) و K-Means هر دو از الگوریتمهای مهم در یادگیری ماشین هستند، اما تفاوتهای عمدهای بین آنها وجود دارد که آنها را برای کاربردهای متفاوت مناسب میکند. KNN یک الگوریتم یادگیری باناظر است که برای مسائل طبقهبندی و رگرسیون استفاده میشود. در این الگوریتم، هر نمونه جدید با تمامی نمونههای آموزشی موجود مقایسه میشود تا نزدیکترین همسایگان (براساس تعداد K) شناسایی شوند. سپس برچسب یا مقدار نمونه جدید بر اساس برچسب یا مقادیر همسایگان نزدیک پیشبینی میشود. به عبارت دیگر، KNN از دادههای آموزشی به عنوان مرجع برای پیشبینی استفاده میکند و نیازمند محاسبه مکرر فاصلهها است که این موضوع میتواند زمان محاسباتی بالایی را برای مجموعه دادههای بزرگ ایجاد کند.

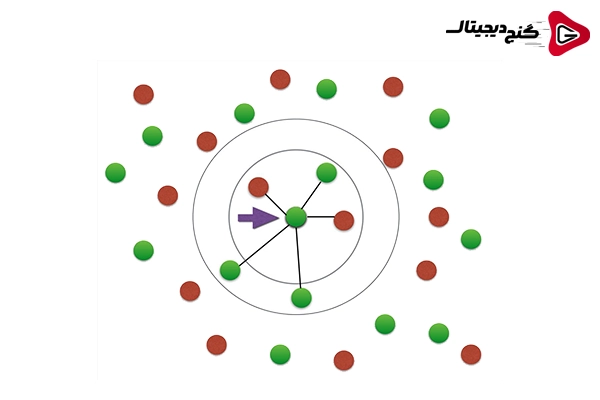

در مقابل، K-Means یک الگوریتم یادگیری بدون ناظر است که برای خوشهبندی دادهها استفاده میشود. هدف K-Means تقسیم دادهها به K خوشه است، به طوری که دادههای درون هر خوشه بیشترین شباهت را به یکدیگر داشته باشند. این الگوریتم با انتخاب تصادفی K مرکز شروع میشود و سپس دادهها را براساس فاصله به نزدیکترین مرکز اختصاص میدهد. پس از آن، مراکز خوشهها براساس میانگین نقاط دادهای هر خوشه بهروزرسانی میشوند و این فرآیند تا زمانی تکرار میشود که مراکز تثبیت شوند. در نتیجه، K-Means بیشتر برای کشف الگوها و ساختارهای پنهان در دادههای بدون برچسب استفاده میشود.

یکی از تفاوتهای کلیدی بین این دو الگوریتم در نوع یادگیری آنها نهفته است. KNN به عنوان یک الگوریتم باناظر به دادههای برچسبگذاریشده نیاز دارد و برچسب نمونههای جدید را بر اساس دادههای موجود پیشبینی میکند. این در حالی است که K-Means بدون ناظر عمل میکند و نیازی به برچسبهای اولیه ندارد، بلکه دادهها را به خوشههایی براساس شباهتها تقسیم میکند.

جمع بندی

KNN (K-Nearest Neighbors) یکی از سادهترین و پرکاربردترین الگوریتمهای یادگیری ماشین باناظر است که برای مسائل طبقهبندی و رگرسیون استفاده میشود. یکی از ویژگیهای برجسته KNN، سادگی و قابلیت توضیحپذیری آن است؛ با این حال، نیاز به حافظه زیاد و زمان محاسباتی بالا در مجموعه دادههای بزرگ از محدودیتهای آن محسوب میشوند. کاربردهای KNN بسیار گسترده است و از تشخیص چهره و توصیهگرهای شخصیسازیشده تا پیشبینی بازار و تحلیل پزشکی را شامل میشود. این الگوریتم به دلیل انعطافپذیری و کارایی، همچنان یکی از انتخابهای محبوب در دنیای یادگیری ماشین باقی مانده است.